Parameter

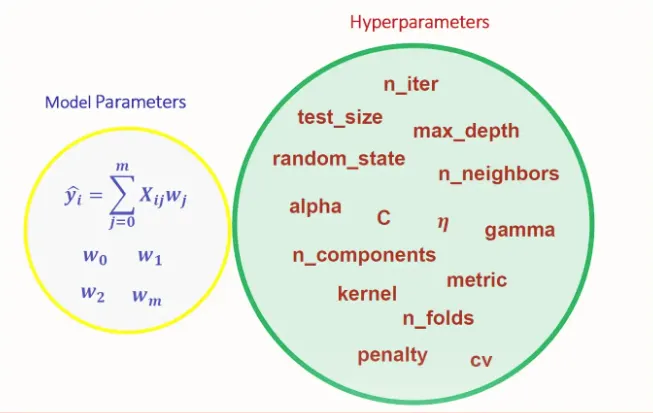

머신러닝/딥러닝에는 2 종류의 파라미터가 있다. 이 2 종류의 파라미터를 통해서 학습을 진행한다.

•

Model Parameters

모델 학습을 통해서 최종적으로 찾게되는 파라미터. 즉, 학습을 하면서 모델이 계속적으로 파라미터 값을 변경하게 된다.

예) weights in Linear Regression

•

Hyper Parameters

모델 학습을 효율적으로 할 수 있게 사전에 정의하는 파라미터.

예) learning rate in LGBMClassifier

하이퍼 파라미터는 최적의 학습 모델을 구현하기 위해 사용자가 지정해주는 값

•

learning rate, max_depth, n_estimators 등 모델별 다양한 변들을이 하이퍼 파라미터에 해당

•

설정한 하이퍼 파라미터 값에 따라 모델의 성능이 달라지기 때문에 파라미터 값을 조정하여 최적의 조합을 찾는 것이 매우 중요

•

HPO를 최적화를 위해서 결정되어야 하는 것은 두 가지이다.

◦

하이퍼 파라미터 탐색 범위

◦

하이퍼 파라미터 탐색 정책(방법)

Manual Search

•

사람이 수동으로 하이퍼파라미터를 변경하는 작업

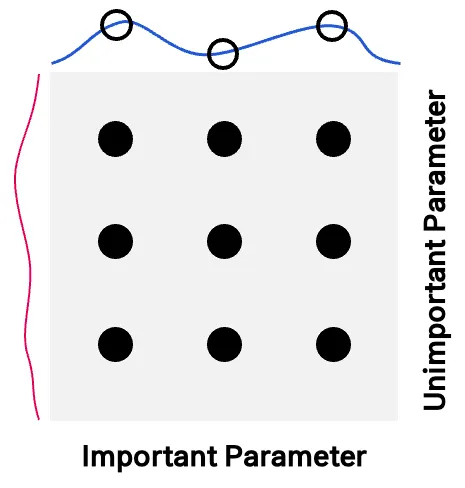

Grid Search

•

특정 하이퍼 파라미터 구간에서 일정 간격으로 값을 선택하여, 선택된 모든 값을 탐색하는 최적해를 찾는 가장 기본적이고 간단한 HPO 기법

•

구간 전역을 탐색하기 때문에 탐색 시간이 오래 걸리고, 균일한 간격으로 탐색하기 때문에 최적해를 찾지 못하는 경우가 발생할 수 있음

Random Search

•

탐색 구간 안에서 임의로 파라미터 값을 선택

•

그리드 서치의 문제점을 보완하기 위해 고안된 기법

•

구간 내 랜덤 조합을 사용하기 때문에 더 많은 지점을 살펴볼 수 있고, 불필요한 반복 탐색이 줄어 그리드 서치보다 탐색 속도가 빠름

Bayesian Search

•

매회 새로운 하이퍼파라미터값에 대한 조사를 수행할 시 사전 지식을 충분히 반영하면서 동시에 전체적인 탐색 과정을 체계적으로 수행할수 있는 방법

•

대체모델이라는걸 이용해서 이전 하이퍼파라미터조합의 적용결과를 기반으로 더 높은 성능점수를 얻는 하이퍼파라미터 조합을 예측하는 방식

일반적 Search 단점

•

Manual Search, Grid Search, Random search 등은 각 파라미터들를 놀릴 뿐이지, 최적의 파라미터를 찾아주지는 못한다.

•

이런 단점들을 해결하기 위해서 나온 방법론이 Bayesian Optimization이다.